温馨提示:要看高清无码套图,请使用手机打开并单击图片放大查看。

1.文档编写目的

在开始Spark学习之前,首先需要搭建Spark的开发环境,可以基于Eclipse或者Intellij等IDE,本文档主要讲述如何使用Intellij搭建Spark开发环境。

- 文档概述

1.安装Intellij

2.安装Scala插件

3.测试Scala环境

4.集成Spark开发环境

- 测试环境

1.Jdk1.8.0_20

2.Scala2.10.5

3.Spark1.6.3 on Hadoop2.6.5

- 前置条件

1.Java环境变量

2.Scala环境变量

3.spark-assembly jar包

2.安装Intellij工具

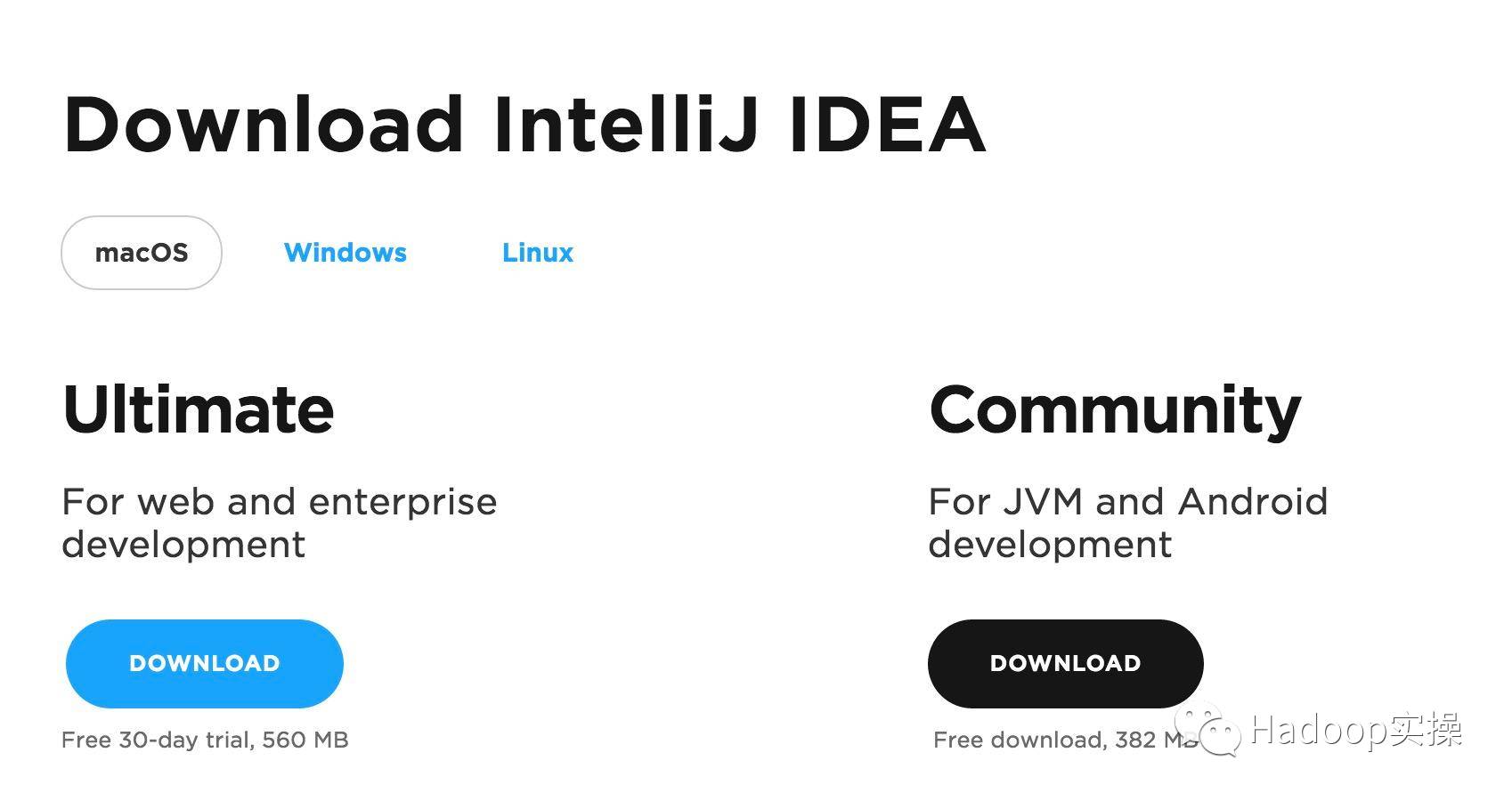

1.下载Intellij开发工具

下载地址:

http://www.jetbrains.com/idea/download

Intellij版本分为Ultimate和Community,根据自己的需要选择下载

下载完成后双击打开,下一步下一步完成,到此就完成Intellij的安装。

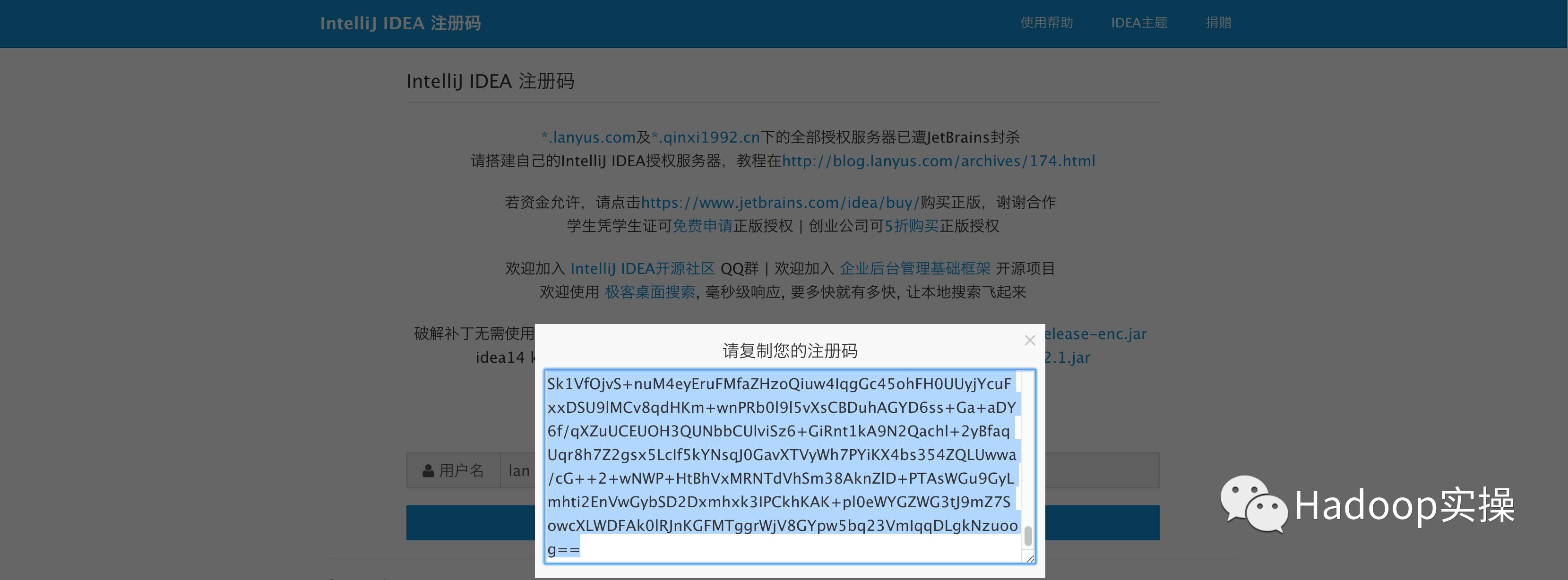

2.获取注册码

如果下载的Ultimate版,需要注册码,注册码可以如下方式获取

注册码地址:http://idea.lanyus.com/

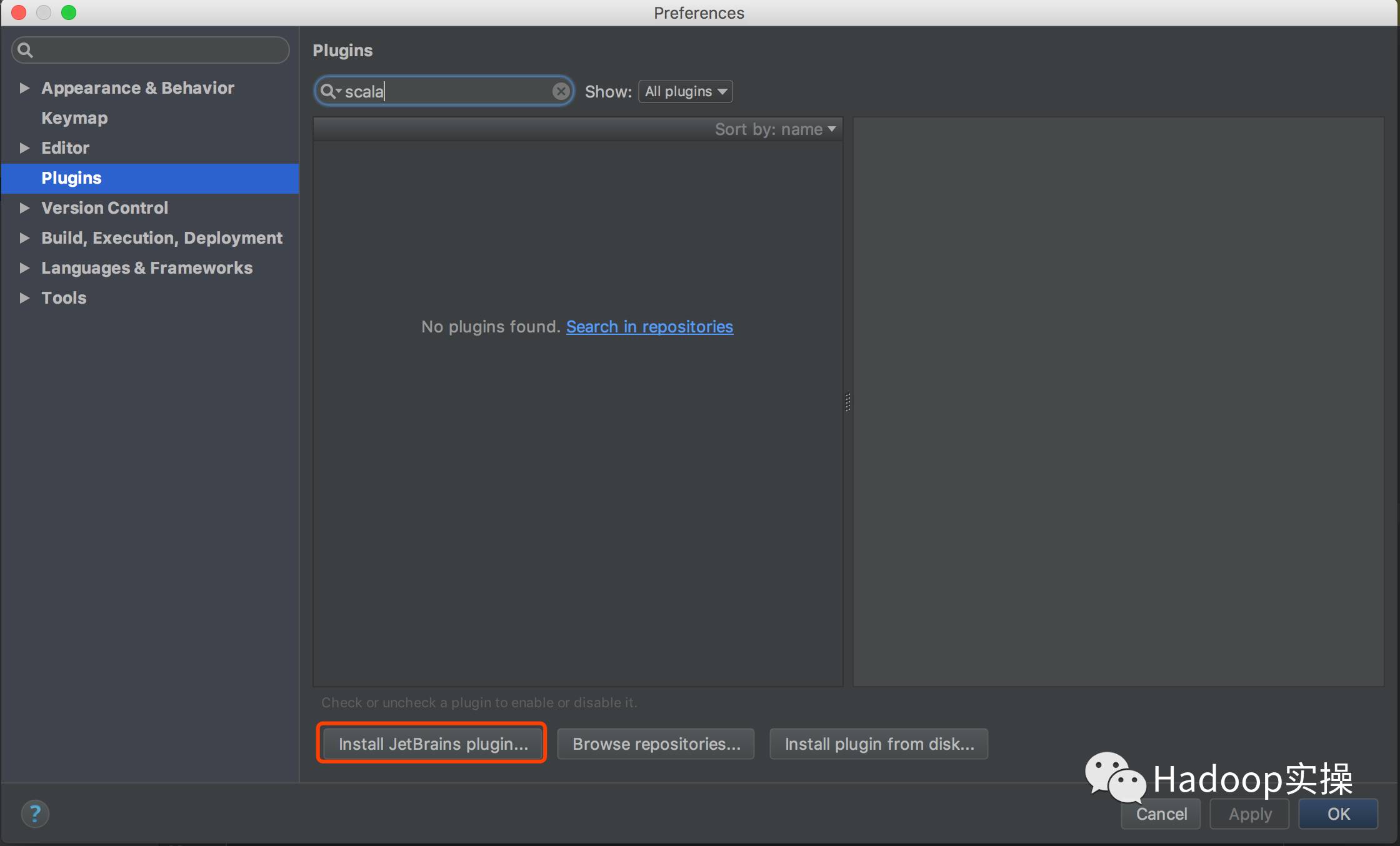

3.安装Scala插件

Scala插件安装分为在线和离线两种方式,网络不稳定时在线安装经常失败,可以选择在官网下载离线安装包,使用离线方式安装。

1.打开Intellij->preferneces->plugins

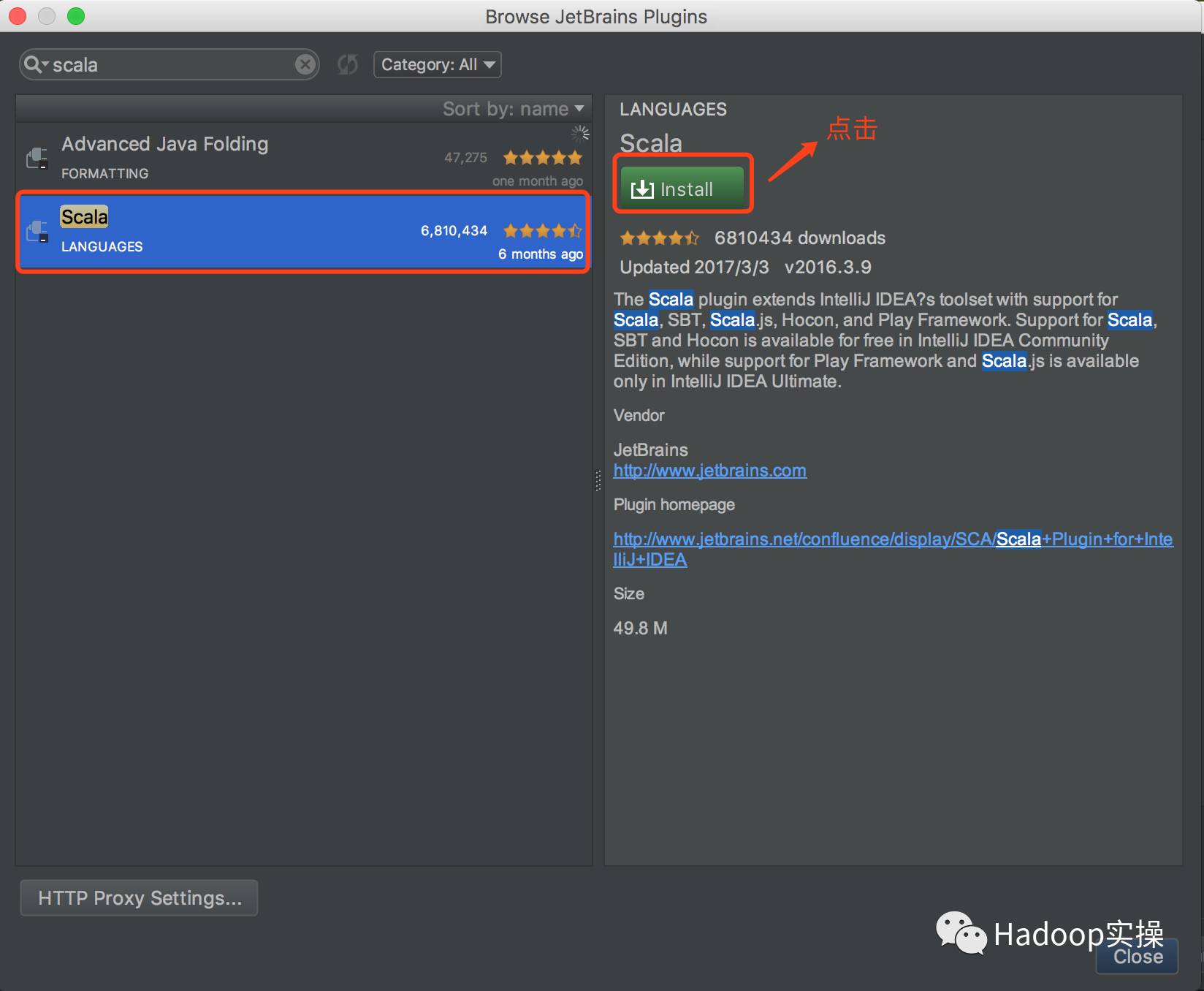

2.在线安装Scala插件

选择Install JetBrains Plugin安装

3.离线安装

- 下载离线安装包

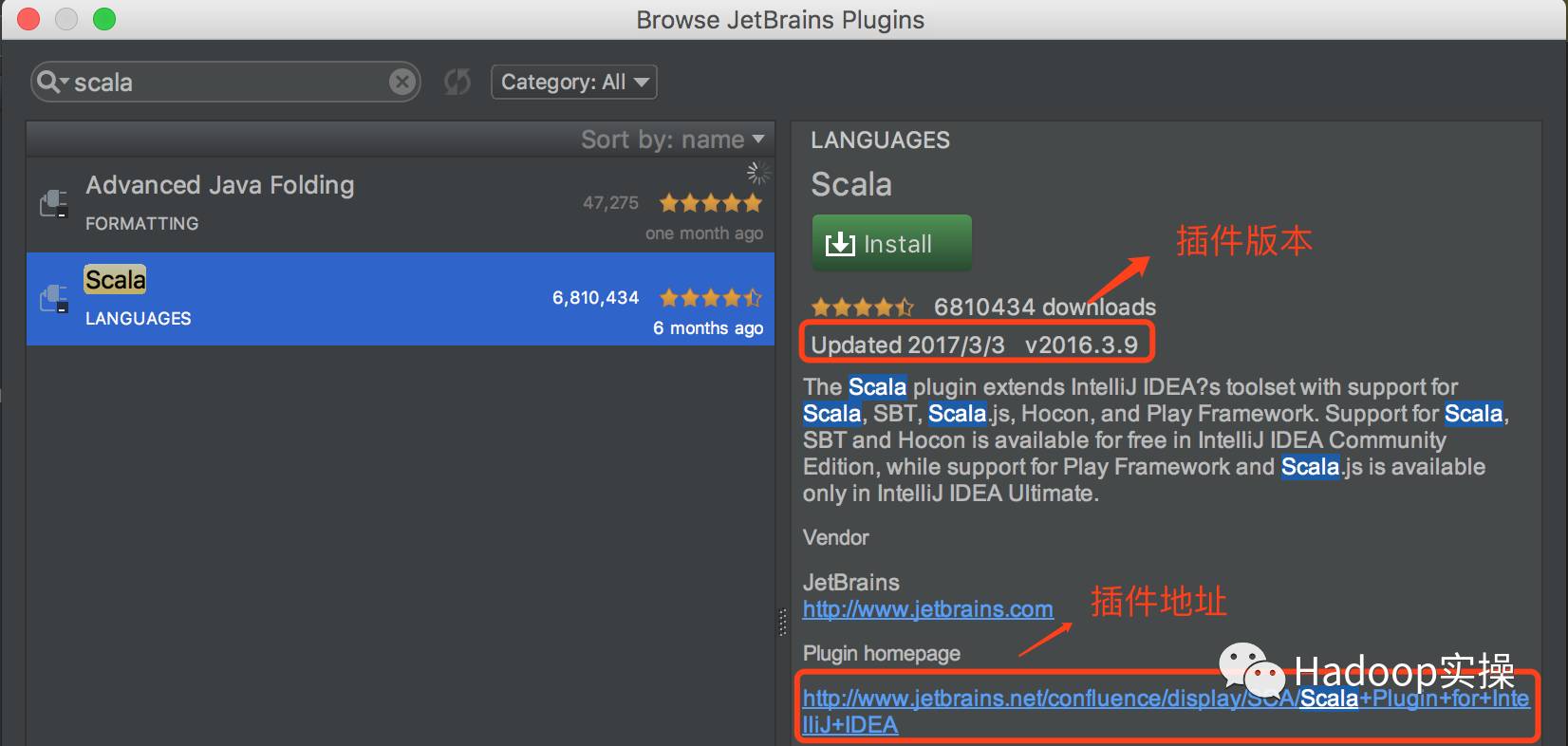

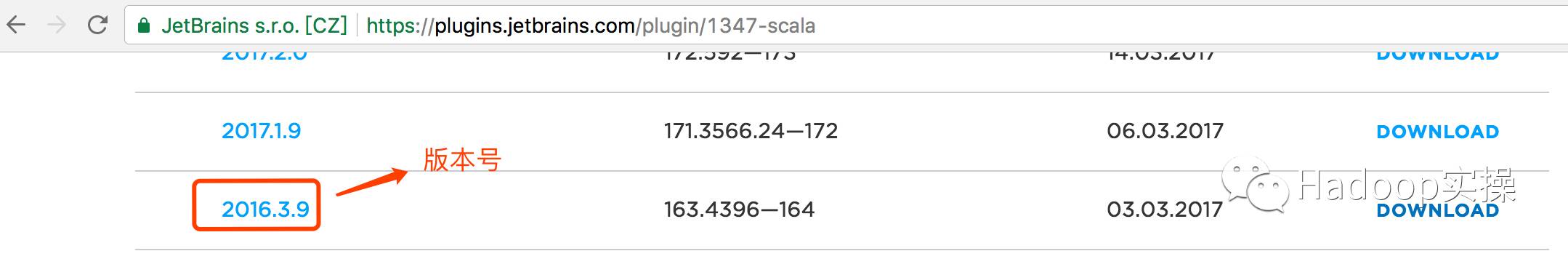

通过在线安装的方式可以获取到插件版本及插件下载地址

离线包下载地址:https://plugins.jetbrains.com/plugin/1347-scala

注意:离线包与插件源里面的版本必须一致,否则会安装失败。

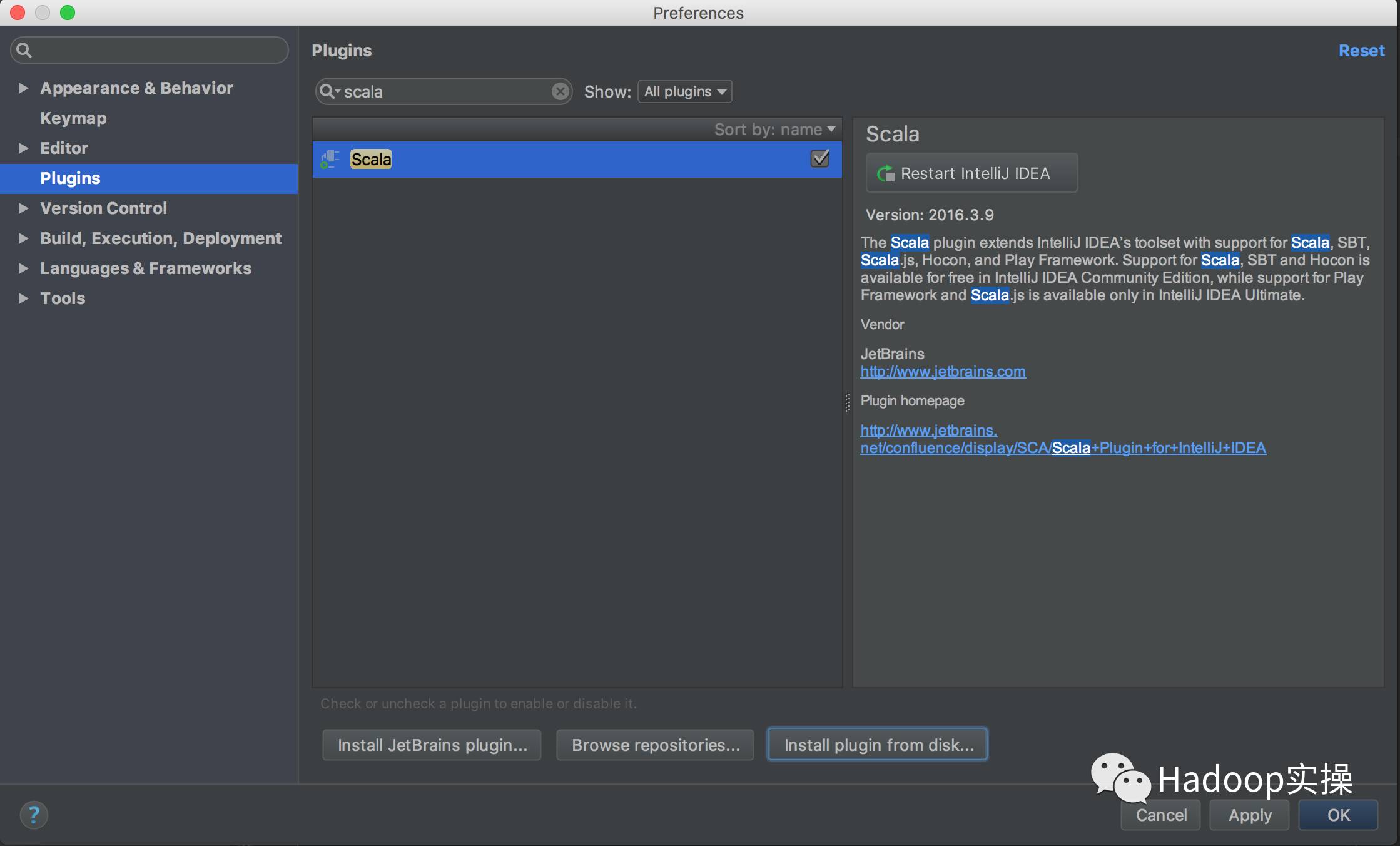

- 选择Install plugin from disk..

安装成功

安装成功后重启Intellij。

4.测试Scala环境

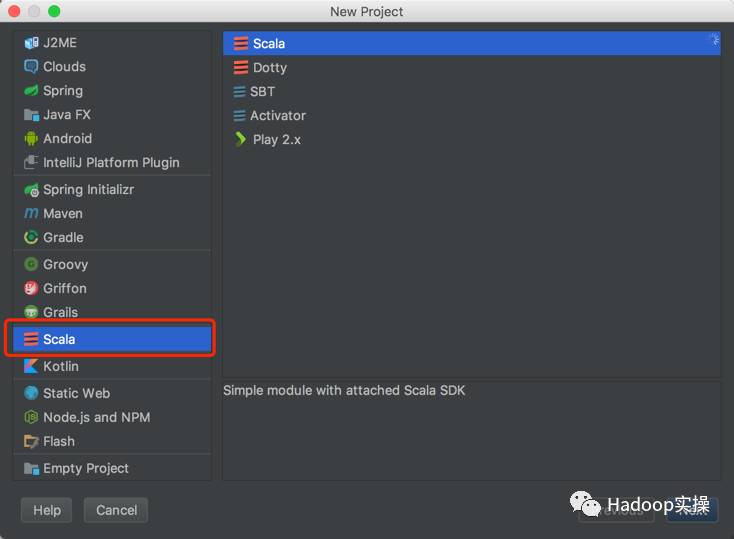

- 创建一个scala工程

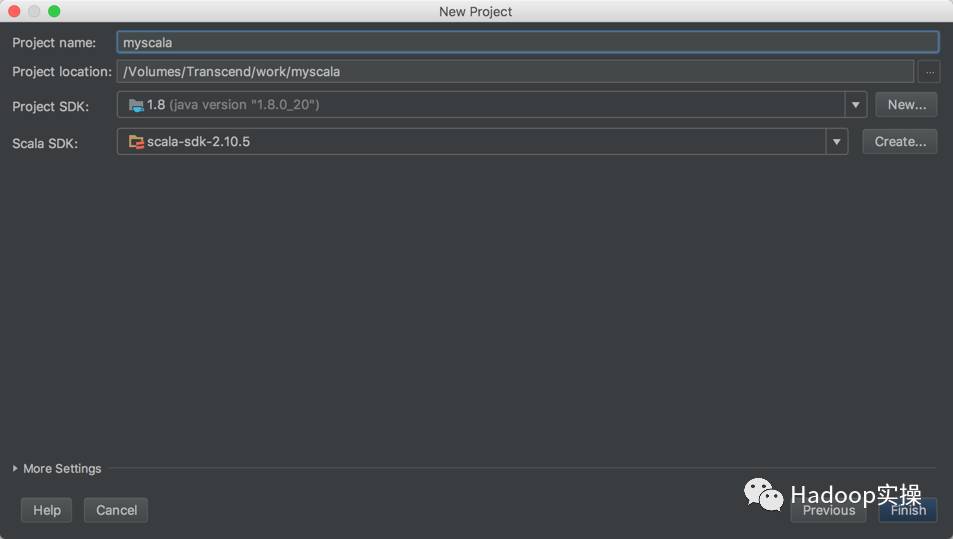

2.点击“Next”,输入工程名称并选择ScalaSDK版本

注:Scala SDK需要到Scala官网下载相应的版,此处使用的版本为2.10.5

SDK下载地址:http://www.scala-lang.org/download/all.html

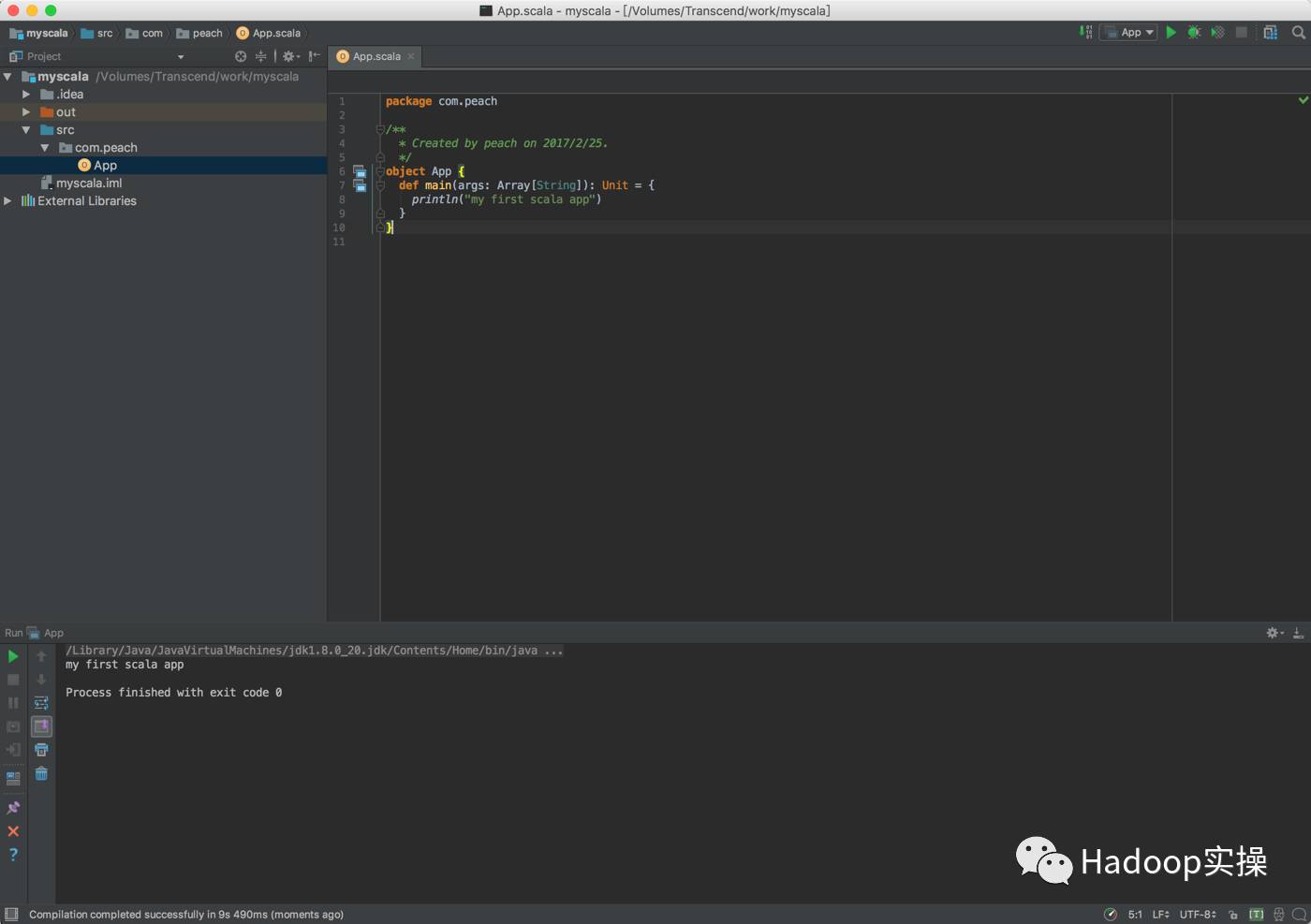

3.工程创建完成,测试Scala代码

5.集成Spark开发环境

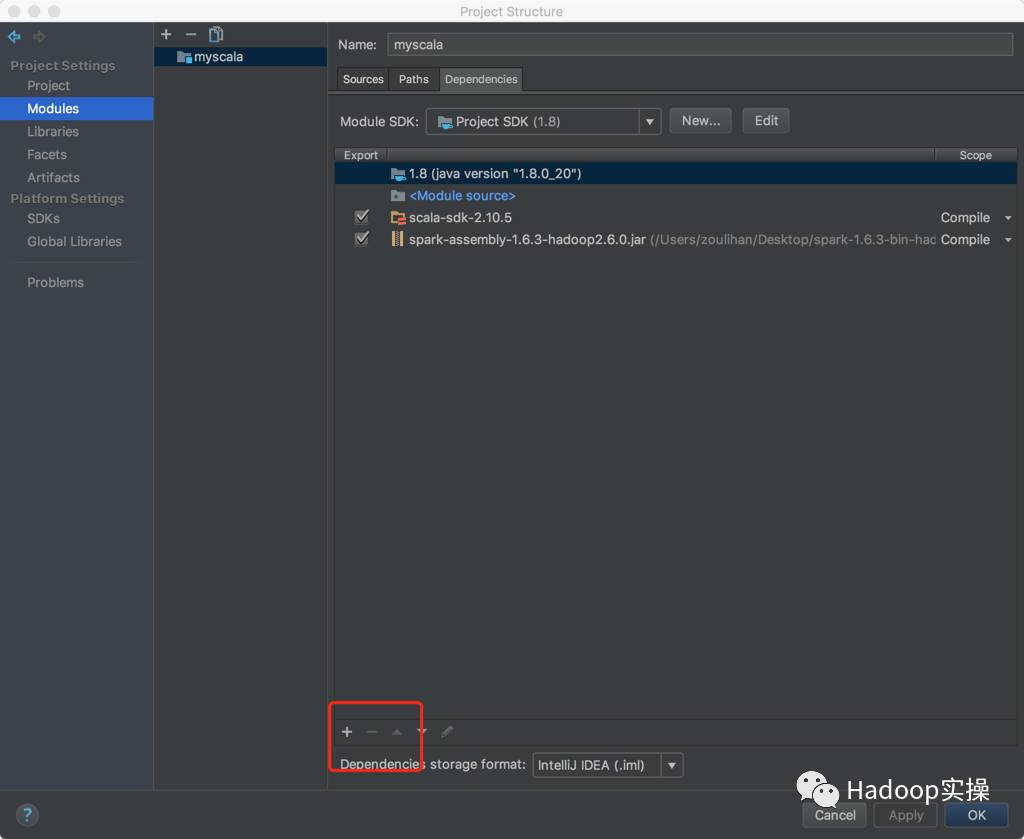

1.首先在spark官网下载spark的jar包,根据自己集群环境下载相应的spark版本,这里我下载的是spark1.6.3与hadoop2.6.5版本

2.将下载下来的spark-1.6.3-bin-hadoop2.6.tgz解压到本地磁盘目录下,在目录中找到spark-assembly-1.6.3-hadoop2.6.0.jar加到myscala工程依赖中

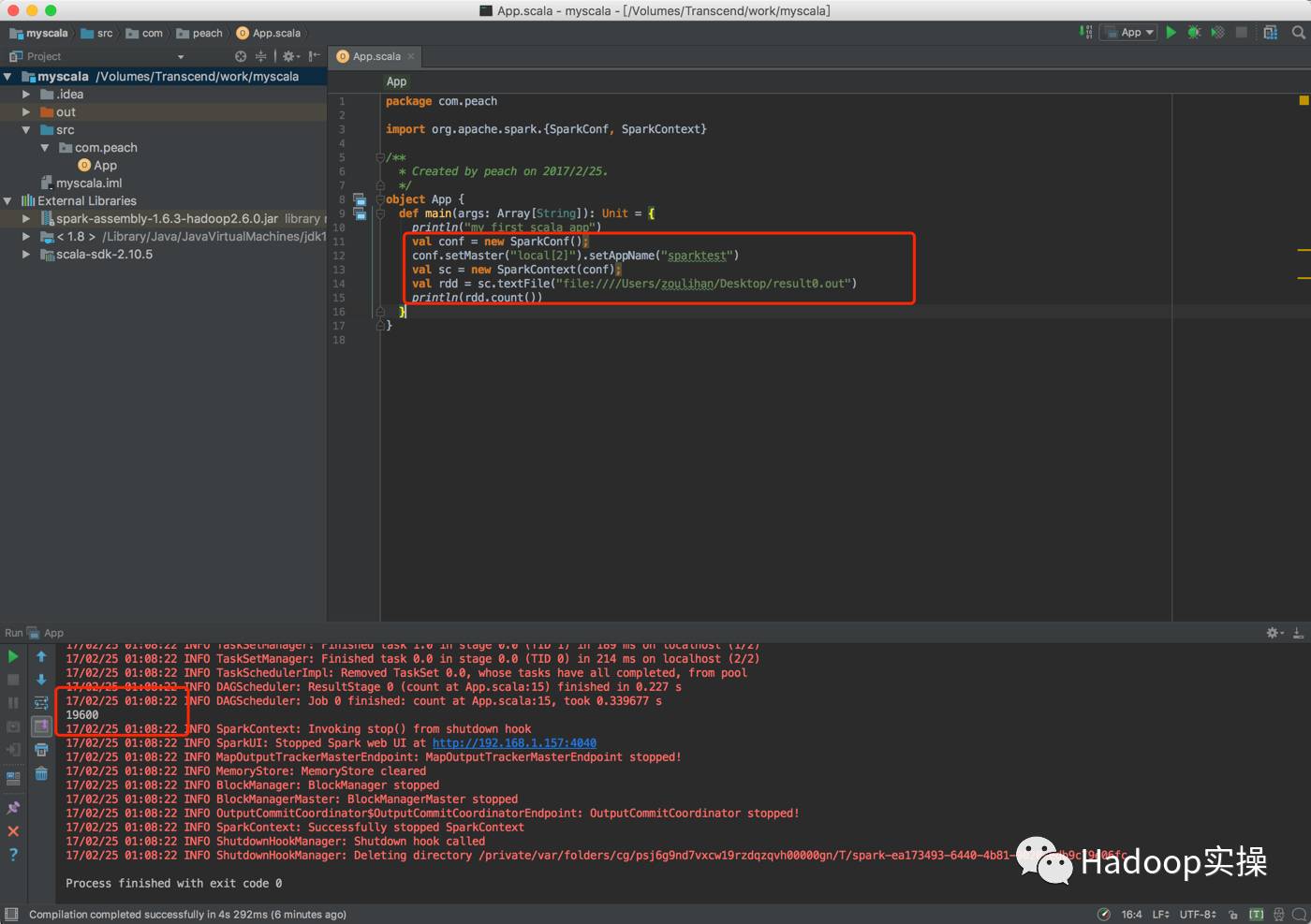

3.添加依赖后,编写spark编码测试,spark环境是否正常

到此Intellij 的Spark Scala开发环境搭建完成。